L’intelligence artificielle ouvre de nouvelles possibilités fascinantes – malheureusement aussi pour les cybercriminels. Ils utilisent de plus en plus les soi-disant deepfakes : des faux fichiers générés par l’IA de vidéos, images ou voix utilisés dans l’environnement de travail pour des attaques apparemment réelles.

Des vidéos, images et voix trompeusement réelles peuvent désormais être créées en seulement quelques minutes grâce à l’intelligence artificielle. Pour les cybercriminels, les deepfakes ont longtemps été un outil de préjudice aux entreprises – que ce soit par la fraude, l’extorsion ou la manipulation ciblée. Une analyse récente de Surfshark montre à quel point la situation est grave : au premier trimestre 2025, il y avait déjà 19 % d’incidents deepfake en plus que sur l’ensemble de 2024.

Notre étude de cas montre clairement comment de telles attaques peuvent fonctionner – et ce que vous pouvez faire pour être prêt.

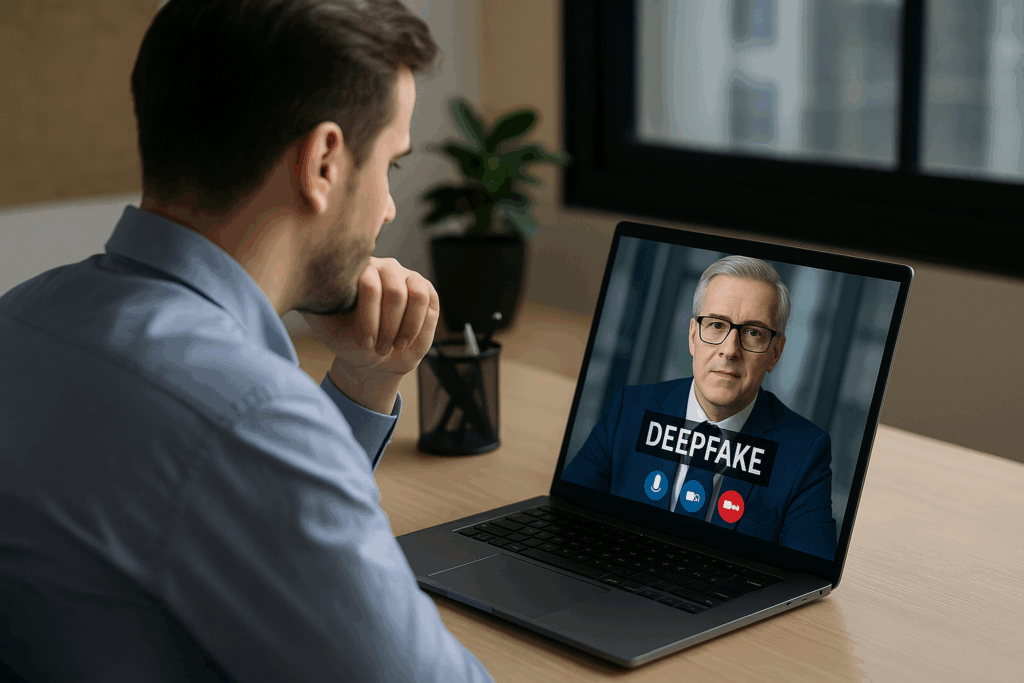

Un employé comptable reçoit un appel vidéo de son directeur général. Une situation qui se produit très souvent dans le travail quotidien. La voix et le visage me semblent absolument familiers.

Le « patron » explique avec force qu’un partenaire commercial japonais attend d’urgence un paiement à six chiffres, qui doit être transféré aujourd’hui. Une échéance importante avait été manquée.

Sous pression de temps et avec l’autorité du supposé supérieur, il demande à l’employé d’effectuer immédiatement le transfert et envoie les données du compte en même temps.

Ce que l’employé ignore, c’est que cet appel est un deepfake trompeusement réel que les criminels utilisent pour tenter spécifiquement de détourner des fonds de l’entreprise vers un compte étranger frauduleux.

Comment les deepfakes apparaissent-ils et quelles technologies les sous-tendent ?

Comment les cybercriminels utilisent-ils les deepfakes pour tromper les entreprises et les employés ?

Quels conseils nos experts donnent-ils pour que les entreprises puissent détecter de manière fiable les deepfakes ?

Quelles mesures sont nécessaires pour se protéger efficacement contre de telles attaques ?