Künstliche Intelligenz eröffnet neue, faszinierende Möglichkeiten – leider auch für Cyberkriminelle. Zunehmend nutzen sie sogenannte Deepfakes: durch KI erzeugte Fälschungen von Videos, Bildern oder Stimmen, die im Arbeitsumfeld für täuschend echte Angriffe eingesetzt werden.

Täuschend echte Videos, Bilder und Stimmen lassen sich heute dank Künstlicher Intelligenz in wenigen Minuten erstellen. Für Cyberkriminelle sind Deepfakes längst ein Werkzeug, um Unternehmen zu schädigen – sei es durch Betrug, Erpressung oder gezielte Manipulation. Wie ernst die Lage ist, zeigt eine aktuelle Analyse von Surfshark: Im ersten Quartal 2025 gab es bereits 19 % mehr Deepfake-Vorfälle als im gesamten Jahr 2024.

Unser Fallbeispiel macht deutlich, wie solche Angriffe ablaufen können – und was Sie tun können, um vorbereitet zu sein.

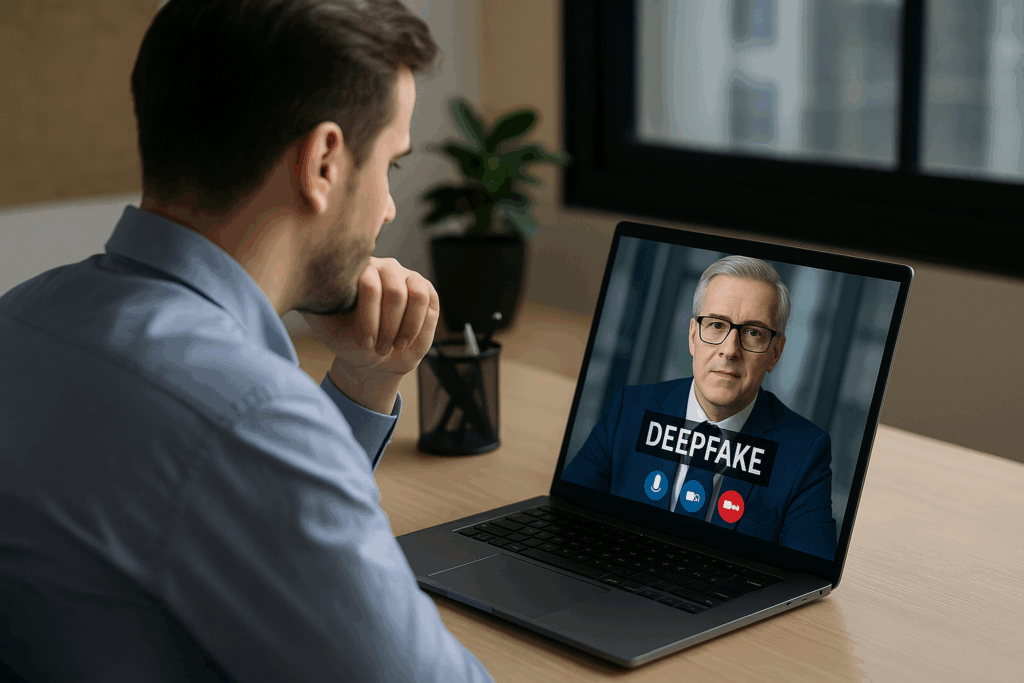

Ein Mitarbeitender der Buchhaltung erhält einen Videoanruf von seinem Geschäftsführer. Eine Situation wie sie sehr häufig im Arbeitsalltag vorkommt. Stimme und Gesicht wirken absolut vertraut.

Der „Chef“ erklärt mit Nachdruck, dass ein japanischer Geschäftspartner dringend eine sechsstellige Zahlung erwarte, die noch heute überwiesen werden müsse. Man habe eine wichtige Deadline verpasst.

Unter Zeitdruck und mit der Autorität des vermeintlichen Vorgesetzten fordert er den Mitarbeiter auf, die Überweisung sofort auszuführen und schickt parallel die Kontodaten.

Was der Mitarbeitende nicht weiß: Bei dem Anruf handelt es sich um ein täuschend echt erzeugtes Deepfake, mit dem Kriminelle gezielt versuchen, Unternehmensgelder auf ein betrügerisches Auslandskonto umzuleiten.

Wie entstehen Deepfakes und welche Technologien stecken dahinter?

Auf welche Weise setzen Cyberkriminelle Deepfakes ein, um Unternehmen und Mitarbeitende zu täuschen?

Welche Tipps geben unsere Experten, damit Unternehmen Deepfakes zuverlässig erkennen können?

Welche Maßnahmen sind notwendig, um sich wirksam vor solchen Angriffen zu schützen?