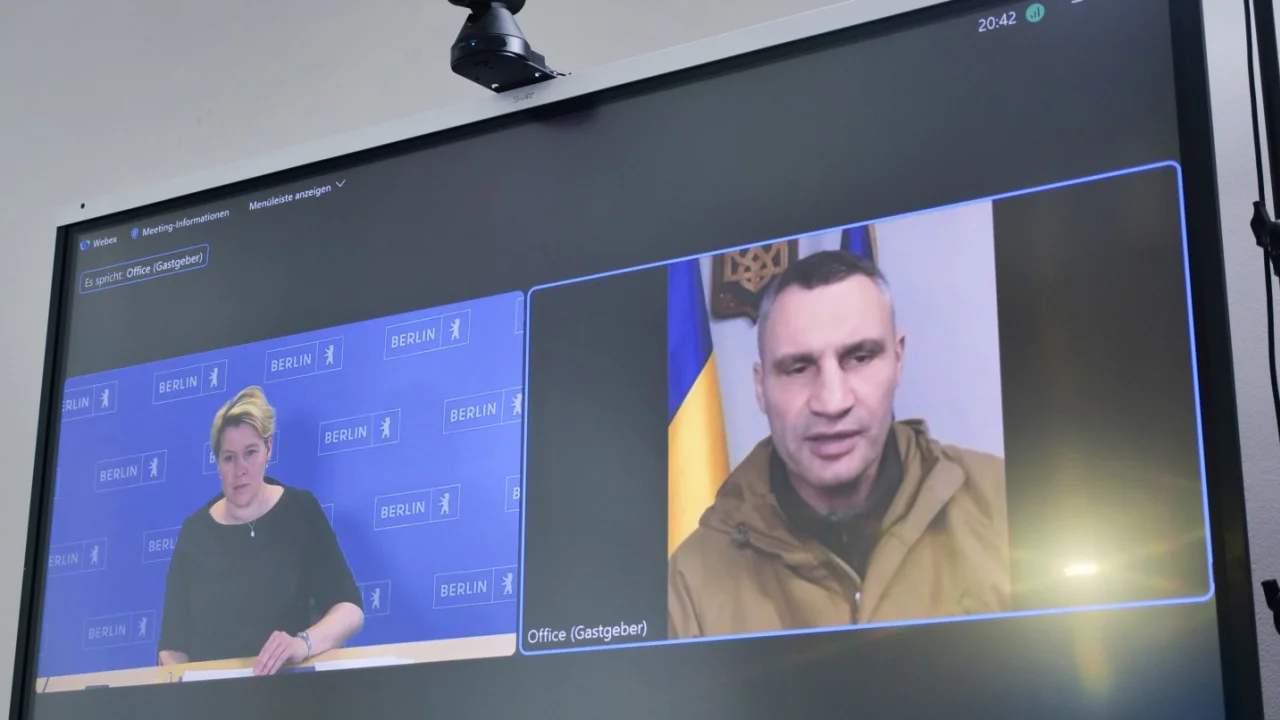

Esta noticia ha causado sensación. El alcalde de Kiev, Vitali Klitschko, llama a la alcaldesa de Berlín, Franziska Giffey. Eso es lo que parecía a primera vista. En realidad, sin embargo, la videollamada era falsa. Al principio no estaba del todo claro si se trataba de un «deep fake» o de un montaje muy profesional a partir de varias grabaciones. Entretanto, sin embargo, se ha sabido que un dúo de cómicos rusos es el responsable del incidente.

Aunque probablemente este incidente no sea un caso de deep fakes, existe cierto riesgo asociado a esta tecnología. En el siguiente artículo explicamos qué son realmente las falsificaciones profundas, cómo se producen, cuándo se vuelven peligrosas y cómo reconocerlas. Esperamos que disfrute de su lectura.

¿Qué ha pasado exactamente?

A finales de junio, el alcalde de Berlín recibió una videollamada del alcalde de Kiev, Vitali Klitschko. A primera vista no era evidente que la llamada fuera falsa. Según Franziska Giffey, las expresiones faciales y los gestos coincidían. Los movimientos de la boca también eran correctos. Sólo tuvo dudas por el curso de la conversación. Cuando surgió el tema de celebrar un Christopher Street Day en Kiev, Franziska Giffey sospechó que algo no podía estar bien e interrumpió la conversación. El mismo juego se repitió en Budapest, Madrid, Viena y quizá en otras ciudades europeas.

¿Cómo se ha podido llegar a esto?

Ahora se sabe que un dúo de cómicos rusos es el responsable de las videollamadas falsas. Utilizaron métodos de ingeniería social para acceder al ayuntamiento y realizar la videollamada. La ingeniería social consiste en recopilar información sobre las personas y, finalmente, utilizarla con tanta habilidad que se establezca una relación de confianza y se transmita información sensible. Según los dos autores, este método es «muy sencillo» y «funciona siempre».

No dan ninguna información sobre cómo se hizo realmente el vídeo. La única información que comparten sobre su ataque es que no se trata de un deep fake.

Pero, ¿qué es realmente un deep fake?

El término «deep fake» procede del inglés y está formado por las palabras deep learning (aprendizaje profundo) y fake (falso). Se trata de falsificaciones que se crean a partir de imágenes, grabaciones de audio y películas con la ayuda de inteligencia artificial. Existen varias formas de deep fakes, algunas de las cuales pueden tener lugar en tiempo real:

- Face Swapping «Intercambia caras entre sí» → Las caras se intercambian entre sí para que las personas aparezcan en situaciones y contextos completamente distintos.

- Voice Swapping «Deja que las personas hablen otros textos» → El contenido de audio se adapta de tal manera que se crea la impresión de que la persona retratada está hablando un texto diferente.

- Body Puppetry «Cambia los movimientos de las personas» → Se transfieren secuencias de movimiento completas a otras personas.

Cómo crear Deep Fakes

Nunca ha sido tan fácil crear deep fakes: Innumerables aplicaciones y programas como Reface o DeepFaceLab permiten crear deep fakes en pocos pasos. FakeApp está incluso a disposición de sus usuarios de forma gratuita y el programa Avatarify permite a sus usuarios transformarse en una persona completamente diferente (avatar) y así aparecer en tiempo real en videochats con Skype, Zoom y Teams.

Como ya se ha mencionado, la inteligencia artificial se utiliza para realizar falsificaciones profundas. Las redes neuronales y los algoritmos analizan el material de audio, imagen y vídeo existente de la persona a imitar y crean nuevos contenidos. Cuanto más material original de una persona esté disponible, más realista parecerá el resultado. Si las aplicaciones basadas en IA disponen de material de una persona en diferentes situaciones, perspectivas y formatos de medios, aprenden rápidamente las características esenciales. La IA puede entonces transferir estas características a otros materiales sin cambiar el entorno.

¿Para qué se utilizan las falsificaciones profundas?

El ejemplo presentado de las llamadas falsas a la alcaldía ilustra muy bien las posibles áreas de uso. Aunque -según los autores- no se trate de un Deep Fake, la motivación está clara. Los cómicos lo llaman «entretenimiento» y «diversión». Las víctimas, en cambio, hablan de «guerra moderna». Esto describe muy bien la situación. Las falsificaciones profundas se utilizan a menudo con fines de entretenimiento, ya que puede ser divertido poner a personalidades conocidas en situaciones oscuras y embarazosas.

Sin embargo, esta técnica también puede convertirse rápidamente en lo contrario y llevar al descrédito de las personas o a la difusión de desinformación y propaganda.

Por qué son tan peligrosos

El gobierno federal también advierte de que las falsificaciones profundas pueden suponer un gran peligro para la sociedad y la política. Especialmente cuando se utilizan para influir en procesos políticos y en la opinión pública.

Los avances técnicos hacen que ya no sea un reto crear Deep Fakes, incluso para aficionados y principiantes. Además, la potencia de cálculo y el rendimiento de la inteligencia artificial aumentan constantemente. Como resultado, la calidad de los deep fakes está mejorando rápidamente. Cada vez es más difícil distinguir la verdad de la manipulación.

Cómo reconocer los Deep Fakes

Los Deep Fakes no le acompañarán en su vida cotidiana. En realidad, el uso de deep fakes es muy específico y depende de la situación. Pero especialmente cuando se abordan aspectos políticos, sociocríticos o explosivos y se utiliza material de vídeo para informar, puede merecer la pena mirar un poco más de cerca. Como en muchos otros casos, primero hay que hacer caso a las corazonadas. Si ves un vídeo de una persona o escuchas una grabación de audio de ella y el comportamiento o lo que se dice te parece extraño o es totalmente contrario a la apariencia y el comportamiento «normales» de la persona, puede tratarse de un caso de manipulación.

Como ya se ha mencionado, puede resultar bastante difícil detectar falsificaciones profundas o incluso falsificaciones y manipulaciones en general debido a los avances técnicos. No obstante, deben tenerse en cuenta los siguientes aspectos:

- Calidad: ¿Puede detectar una diferencia de calidad? ¿Hay partes de la imagen claramente peores o mejores que el resto del material? Por ejemplo, ¿la cara es claramente más nítida que el resto del cuerpo? Si es así, puede que la toma o la imagen se compusiera de elementos diferentes.

- Coherencia: Los rostros de las personas son únicos y tienen ciertas características. Además, su aspecto varía de un día para otro. Así que presta atención a si las tomas son coherentes y la persona aparece siempre retratada de la misma manera. Si de repente desaparecen rasgos claramente reconocibles, podría haber manipulación.

- Cambio de perspectiva: las imágenes creadas artificialmente suelen funcionar muy bien cuando la persona se muestra de frente. Puede volverse más crítica si la persona inclina la cabeza o cambia el ángulo. Si la imagen parece menos nítida y ya no es tan clara, también puedes suponer que se trata de una manipulación.